テコテック++ブログTOP

テコテック++ブログTOP

【生成AIの業務利用】間違えると機密が「人間に見られる」リスクも ~5つの観点によるChatGPT・Claude・Geminiの比較と対処法~

ChatGPT、Claude、Gemini。主要な生成AIに業務データを入力したとき、その内容を人間にも閲覧される可能性があることをご存じでしょうか?

AIの品質改善や安全性の確認を目的として、一定の条件のもと入力データの一部が抽出され、匿名化措置が施された状態でベンダーの担当者などのレビュワーに目視確認されるケースが存在します。データがその対象になるかどうかは、プランや設定によって大きく異なります。

「まあ、大丈夫だろう」 そう思って自社の機密やクライアントデータを入力していませんか。匿名化されたとしても人間に見られる可能性があること自体がリスクとなりますし、その他にも考慮しておくべき点も存在します。業務でAIを利用するなら、プランや設定によるデータポリシーの違いを理解しておく必要があります。

たとえば、「ChatGPT」において、個人向けプラン(Free/Plus等)と法人向けプラン(Team/Business/Enterprise等)では、データの取り扱いが根本的に異なります。個人向けプランでは入力データがAIモデルの学習にデフォルトで利用されますが、法人向けプランではデフォルトで利用されません。「Gemini」においても、個人向けのGeminiと、法人向けのWorkspace版Geminiでは適用されるポリシーが別物です。

「社員がどのAIをどのプランで使っているか」を正確に把握されている企業は、どれほどあるでしょうか。AI利用のガイドラインを設けていたとしても、社員が勝手な判断でAIを使う、いわゆる「シャドーAI」というリスクもあります。

また、プライベートでAIを利用している方も、自分のプランでデータがどう扱われているか気にしたことがある方は少ないようです。

AIの種類だけではなく、プランと設定で判断して安全にAIを使う。今回は、その判断に役立つ5つの観点をご紹介します。

<この記事でわかること>

- 確認した方がよい5つの観点とは何か

- プランごとのデータポリシーの違い

- 主要3社(OpenAI/Anthropic/Google)のプラン別比較

- 利用プランや設定を確認する際のポイント

- 具体的な対処法

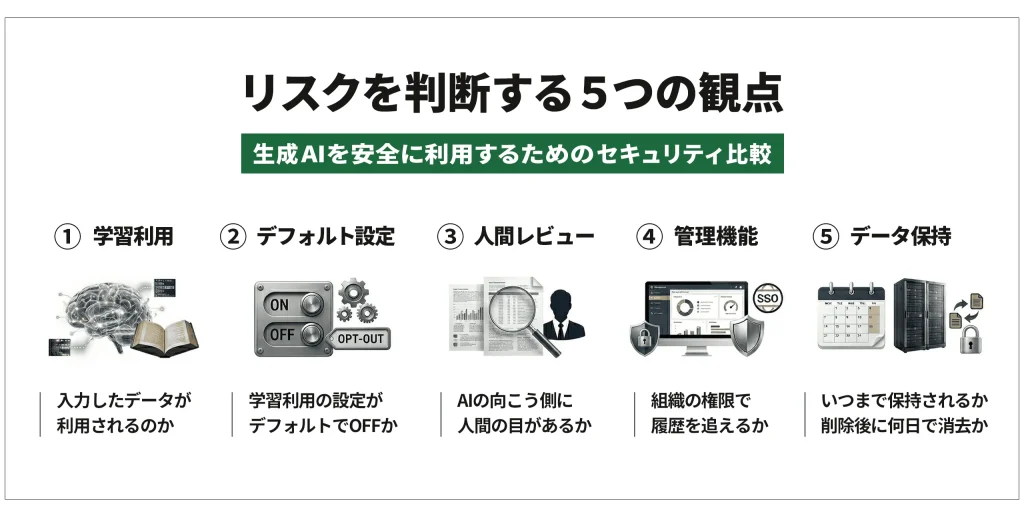

確認すべき5つの観点

AIのデータポリシーを確認する際、何を見ればよいのか。以下の5つの観点を押さえておけば、どのツールにおいても比較に役立ちます。

① AIモデル学習への利用

【要点】 あなたの入力が、モデル改善のための学習データになるかどうか。

学習に利用される場合、入力内容がAIモデルの一部として取り込まれる可能性があります。取り込まれたデータは、第三者への回答として意図せず漏洩してしまうリスクとなります。

また、学習に使われるとデータの保持期間が長期化したり、人間によるレビューの対象範囲が広がるなど、他の観点のリスクにも影響するため、5つの中で最初に確認すべきポイントです。

② 学習利用のデフォルト設定

【要点】 デフォルト設定で学習に使われる前提になっているかどうか。

学習への利用がデフォルトで「ON」なのか「OFF」なのか。

ここが意外と見落とされがちなポイントです。デフォルトでONになっている場合、利用者が自分で設定を変更しない限り、入力データは学習に使われ続けます。また、設定をOFFに変更できる(オプトアウトできる)かどうかも確認が必要です。

③ 人間によるレビュー

【要点】ベンダー側の人間が、条件付きであなたの会話を読む可能性があるかどうか。

入力した内容を、ベンダーの担当者が閲覧する可能性があるかどうかです。

AIの品質改善や安全性の確認を目的として、一定の条件のもとで入力データの一部を人間が確認する仕組みを設けている場合があります。すべての会話が常時チェックされるわけではありませんが、抽出の条件や仕組みはベンダーによって異なり、具体的な抽出アルゴリズムは公開されていません。

なお、主要3社(OpenAI、Anthropic、Google)はいずれも、人間によるレビューが行われる場合に匿名化やアクセス制限といったプライバシー保護措置を設けていると説明しています。

ただし注意点として、「匿名化の措置」があるから「機密情報を入力しても問題ない」ということではありません。

たとえば、取引先の財務資料や顧客の個人情報を含むデータをチャットに入力や添付していた場合、レビュー対象となればその内容が外部の人間の目に触れる可能性もあるわけです。レビュワーはトレーニングされているため、通常はそこから情報漏洩することはありませんが、リスクがゼロとは言い切れません。

各社のプライバシー保護に関する説明は、以下の公式ページで確認できます。

OpenAI :How your data is used to improve model performance

Anthropic:Privacy Policy

Google : Gemini Apps Privacy Hub

④ 管理機能・監査ログ

【要点】組織として、誰がいつ何をしたか追える仕組み(SSO・監査ログなど)があるかどうか。

利用履歴の記録、SSO(シングルサインオン:一つのアカウントで複数のサービスにログインできる仕組み)の対応、利用範囲の制御など、組織として管理できる機能が備わっているかどうかです。法人向けプランと個人向けプランで、差分が最も大きい点です。

⑤ 削除後のデータ保持

【要点】 会話を削除したあとも、サーバー側にどれくらい残るか(学習やレビューの対象データは、削除関係なく長期間残り続けるリスクがある)。

入力したデータが削除された後も、ベンダーのサーバーに保持される期間です。学習利用をオプトアウトしても、一定期間はデータが残ります。セキュリティを重視する場合は、データを処理後に一切保持せず削除する方式に対応しているかどうかも、確認しておきたい点です。

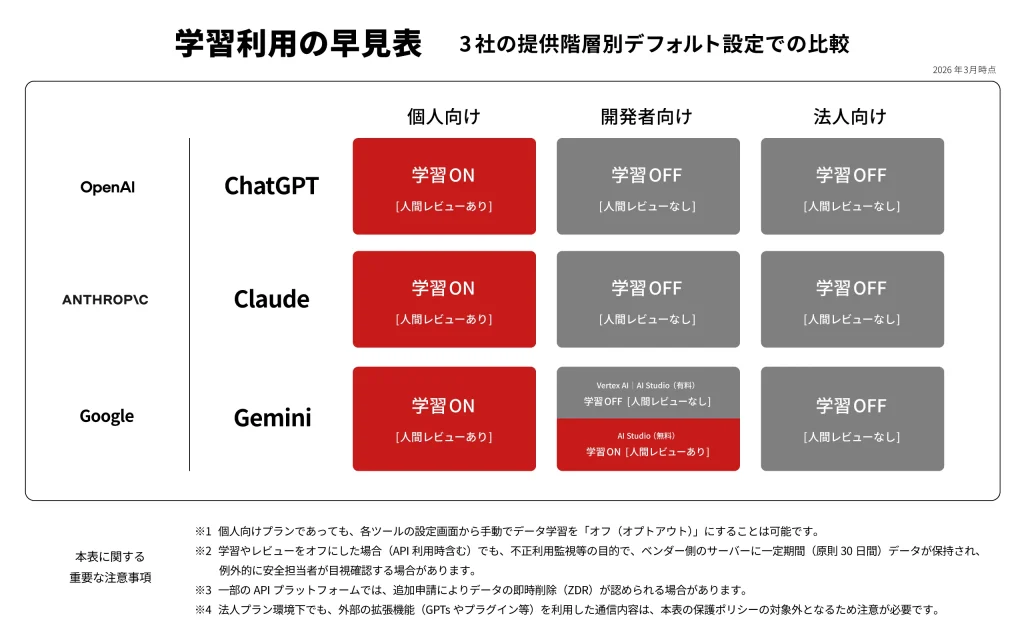

3社のプラン別比較

ここからは、主要3社のデータ取り扱いを、上記5つの観点に沿ってプラン別に整理します。

※以下の内容は2026年3月時点の各社公式ドキュメントに基づいています。

①で触れた通り、学習利用はデータ保持や人間レビューの範囲にも影響する、5つの観点の中で最も根本的な項目となります。まず、この学習利用が3社の提供階層別でどう異なるかを早見表にまとめました。

この後、5つの観点全てを含む比較表と、各社固有のポイントを順に補足していきます。

比較表

個人向けプラン(Free / Plus / Pro等)

| 5つの観点 | ChatGPT(Free / Plus) | Claude(Free / Pro / Max) | Gemini(Free / Plus / Pro / Ultra) |

|---|---|---|---|

| ①学習利用 | あり | あり | あり |

| ②デフォルト設定 |

ON (オプトアウト可) |

ON (オプトアウト可) |

ON (アクティビティ設定で停止可) |

| ③人間レビュー |

あり得る (品質改善目的、匿名化あり) |

限定的 (安全性検知・FB時のみ 匿名化あり) |

日常的 (アクティビティON時、匿名化あり) |

| ④管理機能 | なし | なし | なし |

| ⑤削除後のデータ保持 | 学習ON/OFF:30日 (学習利用時は削除関係なく長期保持あり) |

学習OFF:30日 (学習ON時は削除関係なく最大5年) |

アクティビティ OFF:72時間 | ON:最大2カ月 (レビュー対象は削除関係なく最大3年) |

法人向けプラン(Team / Business / Enterprise等)

※ ✅ は、データ保護の観点で個人向けと比べて有利な規定・体制を示します。

| 5つの観点 |

ChatGPT (Team / Business / Enterprise) |

Claude (Team / Enterprise) |

Gemini (Workspace版:Business / Enterprise等) |

|---|---|---|---|

| ①学習利用 |

✅ なし (デフォルト) |

✅ なし (デフォルト) |

✅ なし (デフォルト) |

| ②デフォルト設定 | ✅ OFF | ✅ OFF | ✅ OFF |

| ③人間レビュー |

✅ 原則なし (インシデント時のみ) |

✅ 原則なし (インシデント時のみ) |

✅ 原則なし |

| ④管理機能 | ✅ SSO / SCIM / 監査ログ |

✅ 監査ログ / SCIM / Compliance API |

✅ 管理コンソール |

| ⑤削除後のデータ保持 | ✅ 30日(長期保持なし) | ✅ 30日(長期保持なし) | ✅ 通常1日(長期保持なし) 履歴OFF時:最大72時間 |

この2つの表を見比べるだけでも、個人向けプランと法人向けプランの間にある差は明らかです。

なお、各社とも開発者向けにAPIでの提供もしています。これは主にエンジニアがプログラムからAIを呼び出す利用形態で、データポリシーが個人向け・法人向けとは異なる場合があります。

開発者向けを含めた各社固有のポイントを補足します。

OpenAI(ChatGPT)

個人向けプラン(Free / Plus)では、入力データがAIモデルの学習にデフォルトで利用されます。設定画面から手動でOFFにすること(オプトアウト)は可能です。

ただし、品質管理や安全性の監視を目的として、全ユーザーの会話データの中から一部が抽出され、人間が確認する可能性があります。現時点では、匿名化された状態でのレビューとされていますが、抽出の具体的な条件やアルゴリズムは公開されていません。

なお、「一時チャット(Temporary Chat)」機能を利用した会話は、学習データとして利用されません。機密性の高い内容を扱う際に活用できる機能です。

法人向けプラン(Team / Business / Enterprise)では、学習利用がデフォルトでOFFになっています。人間によるレビューも原則として行われず、インシデント対応や法的要請といった例外的な場合に限定されています。Enterprise版ではさらにSSO(シングルサインオン)やSCIM(ユーザー管理の自動化)、監査ログ(誰がいつどのような内容を入力したかの記録)といった管理機能が利用できます。

開発者向けプラットフォームであるOpenAI API経由の利用では、デフォルトで学習利用がOFFであり、会話データが即時削除される設定(サーバーに保持されない設定)にも対応しています。

・How your data is used to improve model performance

・Data Controls FAQ

・Chat and File Retention Policies in ChatGPT

・Data controls in the OpenAI platform

Anthropic(Claude)

Claudeは、2025年にプライバシーポリシーが大きく変更されたため、特に注意が必要です。

個人向けプラン(Free / Pro / Max)では、現在デフォルトで学習利用がONに設定されています。以前はデフォルトでOFFだったため、「ClaudeはChatGPTよりプライバシーに配慮している」という認識を持っている方もいるかもしれませんが、現在はChatGPTと同様、利用者が自ら設定画面でOFF(オプトアウト)にしない限り、入力データは学習に利用されます。設定は「Privacy」メニューの「Help Improve Claude」トグルから変更可能です。

人間によるレビューについては、日常的なサンプリングではなく、安全性上の懸念が検知された場合やユーザーからのフィードバック送信時など、特定の条件下でのみ発生する仕組みとされています。レビュー時には匿名化措置が適用されます。

なお、ChatGPTの「一時チャット」と同様に、Claudeにも「インコグニートチャット」機能があります。この機能を利用した会話は、学習利用の設定にかかわらず学習には使用されません。

法人向けプラン(Team / Enterprise)では、学習利用がデフォルトでOFFであり、従来のポリシーが維持されています。

開発者向けのAPI利用(Claude CodeやSDK経由を含む)では、デフォルトで学習利用がOFFです。

・Privacy Policy

・Updates to Consumer Terms and Privacy Policy(2025年8月28日)

・Is my data used for model training?

・How long do you store my data?

・How do I change my model improvement privacy settings?

Google(Gemini) ※ここが最も複雑

Googleの場合、様々な方法でAIの提供がされていますが、すべて同じポリシーで運用されているわけではありません。製品によって、適用されるデータポリシーが大きく異なります。

<個人向けGemini>

入力データがAIモデルの学習に利用される可能性があります。

人間によるレビューについては、「Gemini Appsアクティビティ(履歴の保存)」の設定がON(デフォルト)の場合、製品改善を目的として日常的にレビュー対象の候補となる仕組みです。この設定をOFFにすればレビュー対象からは外れますが、チャット履歴が保存できなくなるというトレードオフがあります。

<法人向けWorkspace版 Gemini>

入力データは学習に利用されません。

Google Workspaceのプライバシーフレームワークが適用され、管理者が管理コンソールを通じて、組織全体の会話履歴の保持期間を「3カ月、18カ月、36カ月、またはOFF(最大72時間で消去)」から選択して制御することが可能です。

<開発者向けGoogle AI Studio(無料)>

Google AI StudioはAPIを利用した開発者向けツールです。

ブラウザ上からGeminiモデルを無料で試せるのですが、Gemini APIの規約が適用され、無料利用分のデータは学習に利用されることが前提となっています。一方、「有料枠(従量課金)」へ切り替えることで、データ保護レベルがEnterprise準拠となり、学習やレビューの対象外となります。

ポイントは、「Googleだから大丈夫」ではなく「どのGoogle製品を使っているか」で判断が分かれるということです。社員が業務で使っているのが個人向けのGeminiなのか、Workspace版なのかによって、データの扱いはまったく異なるわけです。

・Gemini Apps Privacy Hub

・Manage & delete your Gemini Apps activity

・Generative AI in Google Workspace Privacy Hub

落とし穴的な注意点:自分で「削除」しても、すぐには消えない

チャット履歴を削除すれば、画面上からは消えます。しかし、前半の比較表でも言及した通りベンダーのサーバー上では一定期間データが保持され続けるのが、現在のAI業界のスタンダードです。

不正利用の事後検知、法的な開示請求への備え、世界中に分散するサーバーのバックアップ反映にかかる物理的な時間。こうした理由から、主要3社はいずれも削除後のデータ保持期間を設けています。

| サービス | 削除後の基本保持期間 | 条件による延長 | 主な理由 |

|---|---|---|---|

| ChatGPT | 個人/法人:30日間 | 個人:学習利用されたデータは匿名化され削除後も保持される(期間は未開示) 法人:延長なし |

不正利用の監視 法的義務 |

| Claude | 個人/法人:30日間 | 個人:学習ON時は削除関係なく最大5年 法人:延長なし |

安全性モニタリング モデル改善 |

| Gemini |

個人:72時間〜最大2カ月 法人:通常1日以内 |

個人:アクティビティON時は最大2カ月(レビュー対象は削除関係なく最大3年) 法人:延長なし |

サービス維持・製品改善 |

「個人向けプラン」では、設定や条件によって保持期間は大きく異なります。

- ChatGPT

学習利用がOFFの場合でも30日間は保持されます。一方、学習利用がONの状態でデータが抽出(匿名化)された場合、削除したかどうかは関係なく長期保持されます(期間は未開示)。一時チャット(Temporary Chat)を利用した場合でも、学習には使われませんがサーバー上には同様に30日間残ります。

また、AIエージェント機能など新しい機能では、標準の30日とは異なる保持期間が適用される場合があるため、利用する機能ごとに公式ドキュメントの確認を推奨します。 - Claude

学習利用がOFFの場合は30日、ONの場合は削除したかどうかは関係なくデータは匿名化された状態で最大5年間保持されます。 - Gemini

アクティビティ設定がOFFの場合は72時間、ONの場合は最大2カ月間保持されます。なお、人間によるレビューの対象となったチャットは削除したかどうかは関係なくデータを匿名化した状態で最大3年間保持されます。研究データとして扱われるためです。

「削除したから安心」ではなく、「削除後も一定期間はサーバーに残る」ことを前提に、入力する情報を選ぶ意識が大切です。

※本セクションの情報は、前述の各社公式ドキュメント(特に以下)に基づいています。

Anthropic:How long do you store my data?

Google :Gemini Apps Privacy Hub

具体的な対処法

法人向けプランと個人向けプランの間には、データの取り扱いに関して大きな差があることをご理解いただけたと思います。

企業としてAIを業務に利用するのであれば、法人向けプラン(Team / Business / Enterprise等)を正式に導入し、管理された環境で利用するのが最も現実的な対処法です。

法人向けプランであれば、学習利用がデフォルトでOFF、管理機能・監査ログが利用可能、データ保持も管理者が制御できるなど、データ保護の基準が個人向けプランとは根本的に異なります。

注意点として、たとえばChatGPTのGPTs(カスタムGPT)のように外部サービスと通信する拡張機能を利用した場合、入力データは法人向けプランの保護ポリシーの対象外になってしまいます。外部連携機能は業務データを扱う場面では利用は控えておくと安全です。

一方で、社員が個人向けプラン(無料版や個人の有料版を含む)で業務データを入力している状況では、以下のようなリスクが生じます。

- 入力データがモデルの学習に利用され、第三者への回答として意図せず漏洩してしまう可能性がある。

- 匿名化措置があっても、たとえば社内の財務資料や顧客リストを添付して質問していた場合、その内容がベンダー側のレビュワーの目に触れる可能性がある。そこからの情報漏洩リスクはゼロとは言い切れない。

- 管理機能や監査ログがないため、万一の問題発生時に「誰が・いつ・何を入力したか」の証跡が残らず、原因の追跡が困難になる。結果として利用者個人の責任問題に発展する可能性もありえる。

重要なのは、「AIを禁止する」ことではありません。禁止しても、便利なものは隠れて使われる「シャドーAI」となるだけです。

管理された環境を用意して、安全に使える状態を整えるのが現実的な対応となります。

すぐにできること

法人向けプランの導入がすぐには難しい場合や、個人でAIを利用している場合でも、リスクを下げる方法はあります。

- 学習利用の設定をOFFにする

各ツールの設定画面から変更可能で、最も基本的な対策です。 - 一時的なチャット機能を使う

ChatGPTの「一時チャット」やClaudeの「インコグニートチャット」を利用すれば、その会話は学習には利用されません(サーバー上の一時保持は残ります)。 - 機密情報はそもそも入力しない

設定にかかわらず、取引先の情報や個人情報など、流出時に影響の大きいデータは入力しないことが最も確実な防御策です。 - API経由で利用する

技術的なハードルはありますが、API経由であれば多くのサービスでデフォルトの学習利用がOFFになっており、会話データが即時削除される設定(サーバーに保持されない設定)に対応しているケースもあります。

まとめ

この記事では、ChatGPT、Claude、Geminiの3つの生成AIについて、5つの観点でセキュリティリスクと対処法をご紹介しました。

AIの利用規約やデフォルト設定は、頻繁に更新されます。実際に、Claudeは2025年にデフォルトの学習利用をOFFからONに変更しました。ChatGPTのプラン体系も継続的に変動しています。

そのような状況だからこそ、特定の設定値を覚えることよりも、この記事で整理した5つの観点を持っていれば、規約が変わったとしても、ご自身で各社の公式ドキュメントを確認して判断することができます。

「どの観点で確認すべきか」という考え方を身につけておくことが重要になります。

とはいえ、「実際に自社の組織全体で使い方を徹底できるのか?」と感じた方もいるかもしれません。

実務上「社内の管理部門だけで全て対応しきるのは簡単ではない」「自社の担当者だけに依存するのもリスクになる」という側面があるのも事実です。

テコテックでは実際にAIを組織に導入し、セキュリティを踏まえた運用で業務に活用しており知見も豊富です。AIを安全に業務利用するための導入支援も行っており「法人向けプランの選定や適切な進め方を知りたい」「社内のAI利用ガイドラインを整備してほしい」「まず何から手をつければいいのか相談したい」などのご依頼に対応してきております。AIの業務利用でお悩みがありましたらお気軽にご相談ください。

筆者:TECOTEC++blog編集部